Основы классификации (объектов)

Изучив эту тему, вы узнаете:

— что такое классы и подклассы;

— что такое основание для классификации;

— что такое наследование свойств;

— для чего нужна классификация;

— как проводить классификацию разнообразных объектов;

— как классифицируются компьютерные документы.

Классы и классификация

Человеку присуща способность обобщать и упорядочивать все многообразие объектов. Каждое имя существительное отражает представление человека об обширной группе объектов: дом, стол, книга. Объекты одной группы обладают общими для всей группы характеристиками, а также некоторыми чертами, позволяющими отличить их от других объектов.

Человеку свойственно отождествлять несколько объектов, родственных по какому-то признаку, рассматривая их как самостоятельный объект.

Например, про скрипку, виолончель, альт, контрабас, флейту, гобой, фагот, трубу мы говорим, что это «музыкальные инструменты».

Класс — группа объектов с одинаковым набором характеристик.

Объекты, входящие в класс, называются экземплярами класса. Необходимо понять, что объекты, которые вы по каким-то параметрам объединили в класс с общим названием, отличаются друг от друга конкретными значениями параметров. Например, мячи, сохраняя основные свойства данного класса объектов (легкость, упругость), могут различаться материалом (каучуковые, резиновые, кожаные), цветом, размером. Птицами называют орла и курицу, страуса и колибри. Даже внутри узкого класса экземпляры могут сильно различаться: среди крылатых насекомых под названием «пчелы» существует матки, трутни, рабочие пчелы.

Классификация — распределение объектов на классы и подклассы на основании общих признаков.

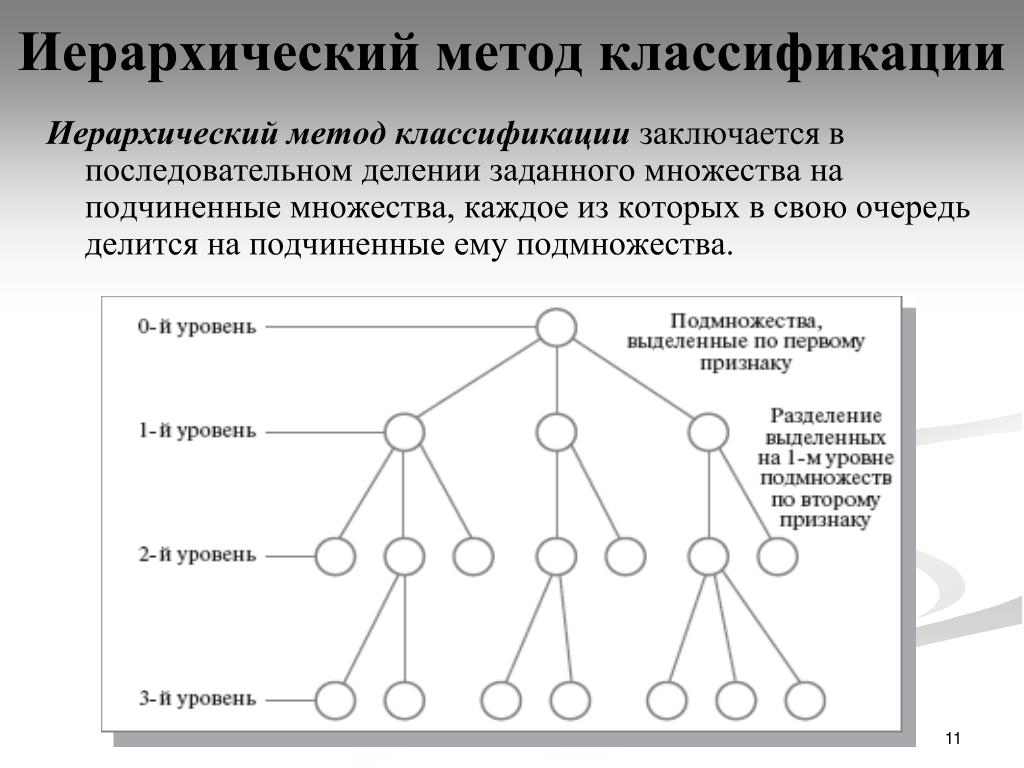

Результаты классификации принято отображать в виде иерархической (древовидной) схемы. Общий вид такой схемы изображен на рисунке 9.1.

Внешне схема классификации напоминает перевернутое дерево, за что и получила название иерархической (древовидной). Пунктирными линиями на схеме выделены уровни иерархии. Самый верхний уровень (корень дерева) задает основные признаки, позволяющие отличить объекты данного класса от других. Каждый следующий нижестоящий уровень выделяет из вышестоящего группы объектов на основании совпадения одного или нескольких признаков. На нижнем уровне располагаются конкретные экземпляры выделенных подклассов.

С подобными схемами вы, возможно, уже встречались при изучении биологии, истории и других предметов.

Рис. 9.1. Общий вид иерархической схемы

В виде такой схемы часто изображают родословную. Ее принято называть генеалогическим древом.

Родословная — перечень поколений одного рода, устанавливающий происхождение и степени родства.

Основание классификации

С известными примерами классификации вы уже знакомы. Например, в биологии это классификация растений и животных. С глубокой древности люди, знакомясь с многообразием форм жизни на Земле, стремились распределить это многообразие по группам. Так сложилась естественная классификация, основанная на наблюдении и группировке по некоторым признакам. Идеи, изложенные в книге К. Линнея «Виды растений», изданной в 1753 году, до сих пор служат исходной точкой йри классификации растений. С того времени используется и двойное название растений: первая часть имени указывает на подкласс (семейство), а вторая — на конкретные особенности экземпляра этого подкласса.

Классификации поддаются не только природные, но и искусственные объекты: в грамматике принято разделение слов по частям речи, в физике — классификация видов движения, в математике — классификация чисел. В их основе лежит группировка объектов по одному или нескольким намеренно выбранным признакам. В разных отраслях науки и техники классы и подклассы могут иметь свои специфические названия: виды, семейства, отделы, разряды, группы и т. п. При этом суть их не меняется.

Рассмотрим объект «книга». Под этим словом мы подразумеваем множество разнообразных книг: художественных и технических, разных авторов, разной стоимости, толстых и тонких, в подарочном издании и в мягкой обложке…

А теперь представьте, что вам необходимо разложить все это многообразие «по полочкам» в буквальном смысле слова, например упорядочить свою библиотеку.

Каждый подойдет к этому вопросу по-разному. Один человек расставит все книги в алфавитном порядке, по фамилии автора. Другой разделит их на жанры: детективы, фантастика, приключения, любовные или исторические романы. Третий поместит их на полки, руководствуясь цветом переплета и размером книг (наверняка вы сталкивались и с таким подходом). Несмотря на разницу в способах классификации, все эти примеры роднит нечто общее: подразделение объектов на «родственные» группы (классы), для которых существует один или несколько общих параметров.

Один человек расставит все книги в алфавитном порядке, по фамилии автора. Другой разделит их на жанры: детективы, фантастика, приключения, любовные или исторические романы. Третий поместит их на полки, руководствуясь цветом переплета и размером книг (наверняка вы сталкивались и с таким подходом). Несмотря на разницу в способах классификации, все эти примеры роднит нечто общее: подразделение объектов на «родственные» группы (классы), для которых существует один или несколько общих параметров.

Во всех приведенных примерах при группировке был выбран общий признак: в первом случае это автор, во втором — жанр, в третьем — цвет и размер. Именно по этим признакам затем производилось выделение из общей массы тех объектов, у которых его значение совпадает.

Таких общих признаков может

быть несколько. Они являются основанием классификации. Выбрав основание, из класса с общим названием «книга» можно выделить подклассы: «книга определенного автора», «книга определенного жанра», «книга определенного размера».

Классификация — творческий процесс, поэтому у каждого человека может получиться своя схема. Один из возможных вариантов выделения подклассов из класса книг показан на рисунке 9.2.

Рис. 9.2. Классификация книг

На первом уровне за основу разбиения книг на две группы выбран признак «вымысел» (да, нет). По этому признаку произошло разделение на художественную и техническую литературу.

На втором уровне признак выделения подклассов можно было бы назвать «форма подачи информации» (художественная проза, поэзия, словари и т. д.).

Третий уровень разбиения можно охарактеризовать признаком «стиль изложения».

Четвертый уровень классификации выделен только для романов, чтобы не загромождать схему. Признаком этого уровня выбран «жанр».

На самом нижнем уровне находятся конкретные экземпляры разнообразных книг.

Наследование свойств

Важнейшим свойством классов является наследование. Это слово вам хорошо знакомо. Дети наследуют от родителей черты характера и внешние признаки. Каждый подкласс, выделяющийся из класса, наследует свойства и действия, присущие этому классу. В приведенном на рисунке 9.2 примере и роман Д. С. Мережковского, и все другие изданные романы, и вся художественная литература вообще — наследуют от класса «книга» общие свойства и действия. Все они напечатаны на бумаге, переплетены и предназначены для чтения.

Из приведенной выше классификации видно, что образовалась иерархическая структура (дерево). Во главе ее класс-пра- родитель — «книга». В самом основании экземпляры подклассов — конкретные книги конкретных авторов.

Такая древовидная структура с общим корнем называется «иерархией наследования». Характеристики и поведение, связанные с экземплярами определенного класса, становятся доступны любому классу, расположенному ниже в иерархическом дереве.

Утверждая, что «книга — источник знаний», вы подразумеваете как все книги вообще, так и конкретную книгу, например «О вкусной и здоровой пище». В этом проявляется наследование.

Для чего же нужна классификация?

□ Классификация позволяет выделить из всего многообразия объектов группы с интересующими исследователя свойствами и сосредоточиться на их изучении.

Предположим, что вы — неопытный огородник, но хотите, используя достижения науки, выращивать на своем участке хорошие урожаи помидоров. Вам незачем штудировать толстый том «Растениеводство», достаточно прочесть книги о семействе пасленовых, а еще лучше — об особенностях выращивания помидоров в вашей местности.

□ Классификация объектов проводится с целью установления наследственных связей между объектами. Свойство наследования позволяет изучать характеристики всех объектов класса, не привязываясь к конкретному экземпляру.

В геологии существует «теория единообразных изменений», которая гласит, что все природные факторы действуют повсюду одинаково. Не надо изучать, как действуют ветры на Уральские горы, так как механизм разрушения гор под воздействием ветров давно исследован, он един для всех случаев. То же относится к землетрясениям, вулканам, наводнениям, селям и т. п.

□ Классификация позволяет систематизировать знания об объектах любой природы и назначения.

Иллюстрацией этого утверждения служит то, что нет ни одной школьной дисциплины, в которой не использовалась бы классификация объектов изучения как средство обобщения информации, получаемой на уроках. Откройте любой учебник и убедитесь в этом.

Примеры классификации различных объектов

Исследуя один и тот же объект с разными целями, можно увидеть его различные грани. Например, врач, описывая конкретного человека, сделает акцент на симптомах возможной болезни.

Психолога заинтересуют черты характера и особенности психики. Социальные службы обратят внимание на возраст, наличие родственников, условия жизни. Поэтому одни и те же объекты можно классифицировать по-разному, выбрав те или иные основания. Вы уже столкнулись в учебнике с примерами различных классификаций. Например, изучая раздел 1, вы классифицируете информацию по разным признакам: по способу восприятия и по форме представления.

На рисунке 9.3 приведен еще один пример классификации информации — по содержанию.

Рис. 9.3. Классификация информации по содержанию

В этой классификации на основании признака «содержание» на первом уровне выделены следующие группы информации:

♦ статистическая — показатели развития производства и общества;

♦ коммерческая — наиболее важные сведения о производственных, торговых и финансовых операциях;

♦ экологическая — сведения о состоянии окружающей среды и влиянии деятельности человека на природу;

♦ политическая — информация о деятельности государственной власти, общественных движений и партий;

♦ другая (демографическая, медицинская и т. д.).

д.).

Все выделенные подклассы характеризуются теми же свойствами (ясность, полнота, актуальность и т. п.) и действиями (обмен, хранение, обработка), что и вышестоящий класс «информация».

Приведем еще один пример классификации, касающейся наиболее значимых систем (рисунок 9.4).

В качестве основания для классификации на первом уровне выбрано участие человека в создании системы (естественные и искусственные).

На втором уровне основанием для классификации был выбран признак «сфера жизнедеятельности человека». Здесь выделены такие подклассы систем:

♦ духовные у касающиеся духовной жизни человека;

♦ технологические у связанные с производственной деятельностью человека;

♦ организационные у обеспечивающие обслуживание всех видов деятельности.

Рис. 9.4. Классификация наиболее значимых систем

На схеме не показано дальнейшее разветвление дерева, так как это сделало бы рисунок громоздким. Но подразумевается, что дальнейшее выделение подклассов возможно. Например, рассматривая класс систем, называемых «Искусство», можно было выделить следующие подклассы по средствам воплощения замыслов авторов: Живопись, Скульптура, Архитектура, Литература, Театр, Музыка, Кино и т. д.

Но подразумевается, что дальнейшее выделение подклассов возможно. Например, рассматривая класс систем, называемых «Искусство», можно было выделить следующие подклассы по средствам воплощения замыслов авторов: Живопись, Скульптура, Архитектура, Литература, Театр, Музыка, Кино и т. д.

Наряду с устоявшимися и общепризнанными классификациями имеет право существовать любая классификация объектов, если за ее основу взят характерный признак и соблюдены правила выделения классов и подклассов. На рисунке 9.5 приведен пример классификации используемых в реальной жизни и встречающихся в сказках средств передвижения.

Здесь на нулевом уровне расположен класс объектов с общим названием «средства передвижения».

На первом уровне выделено два подкласса по признаку «реальность» (существуют в реальной жизни или в сказках, фантазиях).

Рис. 9.5. Классификация средств передвижения

Второй уровень выделяет из реальных и сказочных средств передвижения новые подгруппы по признаку «среда передвижения».

Третий уровень делит реальные средства передвижения на подгруппы по признаку «вид транспортйого средства». На схеме не указано выделение подгрупп из реальных наземных средств передвижения, чтобы не загромождать ее. Но эти группы могли быть следующими: рельсовые, дорожные. Возможно и дальнейшее подразделение. Важно понять, что нижние уровни наследуют все характерные признаки, свойственные более высоким уровням: например, объект Ка-26, принадлежащий к подклассу вертолетов, наследует от вышестоящего уровня среду перемещения (воздух), а также является реальным средством передвижения со всеми сопутствующими признаками (существует в реальной жизни, осуществляет перевозки людей и грузов).

Классификация компьютерных документов

В самом общем смысле компьютер можно назвать инструментом для обработки информации. Для этого существует множество разнообразных программных сред. Разработчики постоянно совершенствуют программы, упрощая работу с ними и предусматривая в них новые возможности.

Чтобы не «утонуть» в море программных продуктов, пользователь очень хорошо должен представлять, с какой информацией ему предстоит работать. Каждая программная среда предназначена для создания документов определенного вида.

На практических занятиях вы уже познакомились со многими видами компьютерных документов, которые будут упоминаться при классификации документов.

Приведенная на рисунке 9.6 схема показывает классификацию, в которой в качестве основания выбран признак «назначение документа». Основным назначением компьютерных документов является представление информации в удобном для пользователя виде. В таблице 9.1 дана более конкретная характеристика каждого класса документов.

Рис. 9.6. Классификация компьютерных документов

Обратите внимание, что название среды, как правило, совпадает с видом документа и формой представленной в нем информации.

Приведенная классификация поможет вам выбрать среду в соответствии с предполагаемой формой представления информации.

В настоящее время документы, используемые в различных областях человеческой деятельности, создаются на компьютере. Рассмотрим примеры документов различного назначения и сферы применения.

Литературное произведение, газетная статья, приказ — примеры текстовых документов.

Рисунки, чертежи, схемы — это графические документы.

Таблица 9.1. Виды компьютерных документов

Бухгалтер на предприятии представляет в табличном виде данные для расчета зарплаты сотрудников. Основная особенность электронных таблиц состоит в том, что они позволяют не только представлять информацию в табличной форме, но и производить автоматические вычисления по формулам, связывающим ячейки таблицы.

Один из видов компьютерных документов — база данных. Она представляет собой совокупность упорядоченных сведений об объектах. В обычной жизни вы не раз встречались с базами данных. Это и картотека с названиями книг в библиотеке, и телефонный справочник, и каталог товаров. В настоящее время вместо обычных «бумажных» баз данных повсеместно создаются компьютерные, представленные документами соответствующего вида. Диспетчер справочной службы имеет в своем распоряжении всеобъемлющую компьютерную базу данных, позволяющую ответить на любой ваш вопрос. Система управления базой данных обеспечивает быстрый поиск интересующей вас информации.

В настоящее время вместо обычных «бумажных» баз данных повсеместно создаются компьютерные, представленные документами соответствующего вида. Диспетчер справочной службы имеет в своем распоряжении всеобъемлющую компьютерную базу данных, позволяющую ответить на любой ваш вопрос. Система управления базой данных обеспечивает быстрый поиск интересующей вас информации.

Текст, графика, таблица, база данных — это примеры документов, в которых представлена информация какого-то одного вида.

Однако наиболее часто мы имеем дело с составными документами, в которых информация присутствует в разных формах. Такие документы могут содержать и текст, и формулы, и рисунки, и таблицы, и многое другое. Школьные учебники, журналы, газеты — это хорошо знакомые всем примеры составных документов.

Для создания составных документов используются программные среды, в которых предусмотрена возможность представлять информацию в разных формах.

Развитие программного обеспечения привело к тому, что в настоящее время появились новые виды компьютерных документов. В частности, это презентации и гипертекстовые документы.

В частности, это презентации и гипертекстовые документы.

Презентация представляет собой совокупность компьютерных слайдов. Специальная программа обеспечивает не только подготовку информации, но и показ ее по заранее созданному сценарию.

Гипертекст — это документ, который содержит так называемые гиперссылки на другие части документа или другие файлы, где содержится дополнительная информация.

Контрольные вопросы и задания

1. Для чего нужно классифицировать объекты?

2. Что лежит в основе любой классификации?

3. Приведите пример классификации объектов по общим свойствам.

4. Приведите пример классификации объектов по общим действиям.

5. Может ли среда существования стать основанием классификации?

6. Произведите классификацию объектов с общим названием «велосипед».

7. Классифицируйте домашнюю посуду по следующим признакам: материал, назначение, долговечность.

8. Предложите несколько вариантов упорядочения (классификации) разнообразных объектов на вашем письменном столе.

9. Назовите основание, по которому в одну группу могли бы попасть следующие объекты:

■ кенгуру, утконос, кролик, броненосец;

■ роза, колесо, футбольные бутсы, кактус;

■ молоко, бензин, кислота, магма.

10. Назовите разнородные объекты окружающего мира, которые вошли бы в одну группу по основанию «одно вещество».

11. Какие классификации используют в вашей школьной среде?

12. Перечислите наиболее распространенные группы компьютерных документов.

13. Приведите примеры классов программных продуктов. Какое можно выбрать для этого основание классификации?

14. Какое основание классификации можно использовать для выделения групп аппаратной части компьютера?

15. Какие вы знаете классы памяти компьютера?

примеры и заблуждения / Хабр

Это завершающая статья из цикла классификации моделей. В данной статье я классифицирую конструкции. Должен извиниться за отсутствие иллюстраций, но так получилось. Поэтому сегодня просто текст. Должен предупредить, что данная статья опирается на предыдущие мои статьи, в которых подробно описано, что объект, операция и функция — объекты, имеющие лишь разную трактовку.

Термины

Начнем с термина «есть часть». В быту мы встречаем следующие высказывания: слоны – есть часть млекопитающих. Речь идет о том, что множество слонов есть подмножество множества млекопитающих. В этой статье термин «есть часть» будет употребляться в другом смысле. Мы будем употреблять этот термин только в отношении конкретных объектов. Например, конкретная ветка дерева – есть часть конкретного дерева. При этом не надо думать, что речь идет о любой ветке дерева, как тогда, когда мы даем определение понятию: ветка дерева – есть часть дерева. В терминах матлогики это утверждение читается так: для любой ветки дерева найдется такое дерево, что данная ветка есть часть этого дерева. Такое утверждение относится уже не к конкретному объекту, а к понятию, определяющему объекты. Если в статье понадобиться сказать так, я скажу явно. В противном случае я буду говорить о конкретных объектах.

Следующий термин «включает в себя». Если я говорю, что дерево включает в себя ветку, то это значит, что конкретная ветка – это часть конкретного дерева. И речь по-прежнему идет о конкретных объектах, а не о множествах или понятиях.

Еще один термин, разобраться с которым будет немного сложнее. Это термин «состоит из» Кажется, что он близок к термину «включает в себя», но мы будем их различать. Мы говорим, что дерево состоит из веток, ствола и корней. При этом подразумеваем, что части дерева перечислены полностью, чтобы дать нам полное представление о строении дерева. То есть, термин «состоит из» употребляется в отношении строений (конструкций) объектов. Если взять часть из этих объектов, то сказать, что над-объект состоит из этих под-объектов уже не получится (что-то упущено). Поэтому правильна такая иерархия: над-объект, конструкция над-объекта, элементами которой являются под-объекты и из которых она состоит, под-объект, являющийся частью над-объекта и являющийся элементом конструкции над-объекта.

Парадигмы конструкций

Один над-объект может быть представлен в виде разных конструкций. Над-объект может быть поделен на части в соответствии с разными принципами деления (разными основаниями). Есть принцип деления, сохраняющий компактность пространственных частей — пространственное деление. Пример: здание состоит из помещений. Напомню, что тезис «здание состоит из помещений» равносилен утверждению: есть здание, есть конструкция здания, выполненная в рамках пространственной парадигмы, элементами которой (конструкции) являются помещения. Другое основание – функциональное. Пример: здание состоит из ограждающих конструкций, кровли и инженерных подсистем. Другими словами, можно сказать, что основание для деления над-объекта – это парадигма конструкции.

Конструкции человеческого тела часто рассматривается в двух парадигмах: одна называется внешнее строение человека, вторая — внутреннее строение. Внешнее строение описывает части человеческого тела: руки, ноги, голову, туловище. Внутреннее строение описывает подсистемы человека: кровеносную, пищеварительную, нервную и проч. Внешнее строение равносильно пространственному делению здания на помещения. Внутреннее строение равносильно функциональному делению здания по подсистемы.

Классификация конструкций

Обычно мы рассматриваем конструкцию просто: вот над-объект, вот под-объекты, вот связи между под-объектами, которые объясняют нам свойства над-объекта. Мы будем классифицировать конструкции через классификацию элементов конструкции.

Элементы конструкции принадлежат тому же классу, что и объект

Рассмотрим конструкцию, в которой элементы принадлежат тому же классу, что и над-объект. Например, вода состоит из частей, каждая из которых – тоже вода. Или куча песка, элементы которой – тоже кучи песка. Если объект делится подобным образом, то для него зачастую можно ввести меру. Это — особенность такого рода конструкций. Например, масса объекта равна сумме масс ее частей, площадь фигуры равна сумме площадей ее частей, объем материи равен сумме объемов ее частей и тд. Рассмотрим пример менее очевидный. Пусть есть операция и ее части – под-операции. Тогда мерой может стать ее четырехмерный объем. Пример: человек выполнял операцию 4 часа. Объем операции– 4 человеко-часа. Пусть мы разделили операцию на 4 под-операции. Каждая под-операция пусть имеет объем – 1 человеко-час. Таким образом, сумма объемов под-операций равна объему над-операции.

Заблуждение

Замечу, что многие здесь сделают ошибку и подумают, что я говорил о понятии операции. Нет, в данном контексте речь шла о конкретной операции, совершенной Васильевым с 12-00 по 16-00 12-го апреля 2016 года. Если же говорить о понятии операции, то нельзя сказать, что понятие длится 4 часа. Можно сказать, что операции подобного типа длятся в среднем 4 часа. Я же часто (даже от ведущих аналитиков) слышу ошибочные высказывания на эту тему. Они говорят, что операция, которую они обозначили в нотации BPMN в виде прямоугольника длится 4 часа. Но нотация BPMN не моделирует операции, она моделирует понятие операции. Поэтому в этой нотации нельзя сказать, сколько длится конкретная операция. В свойствах объекта, созданного в нотации BPMN может быть атрибут: средняя длительность операций данного типа, но не может быть атрибута длительность операции. В продукте

Businessstudioименно так и сделано. В свойствах объекта, созданного в нотации EPC или в нотации можно указать распределение длительностей операций определенного типа. И это верно.

Примеры конструкций первого типа

Примеры подобных конструкций: операция по постройке дома представлена в виде конструкции, состоящей из операций, которую мы наблюдаем на сетевом графике строительства дома. Диаграмма в нотации IDEF0 моделирует конструкцию функции, состоящую из функций.

Ошибочный пример: некоторые могут подумать, что на диаграмме BPMN подпроцесс – это конструкция операции, но это не так. На диаграмме BPMN нет моделей операций. Там есть концептуальные модели операций. Очень похоже на определение понятия, и так оно и есть. Квадратик в BPMN моделирует не операцию, а понятие об операции. Диаграмма в нотации BPMN – концептуальная модель, а не модель объекта.

Класс конструкций, в котором элементы принадлежат одному классу

Конструкция такого рода состоит из элементов, относящихся к одному классу в то время, как над-объект относится к другому классу.

Например, конкретная будка состоит из конкретных четырех досок. Понятно, что объем будки не равен сумме объемов досок, поэтому ввести меру не удастся. Пример из описания активности: операция состоит из участников. Мы воспринимаем участников как материальные, либо как функциональные объекты, но не воспринимаем их как операции. В данном случае я опять хочу подчеркнуть, что мы говорим не о концептах операций, модель которых можно найти в нотациях BPMN, а об операциях, модели которых можно найти на диаграммах Ганта. Например, участниками операции «забить гвоздь», которая состоялась в 9-00 13-го мая 2011 года были: Сидоров, молоток, гвоздь, две доски, табуретка, лампа, стол, помещение.

Если кто-то попытается сказать что-то подобное об объектах, созданных в нотации BPMN, то это должно звучать так: каждая операция данного типа, модель которого (типа) мы видим в нотации BPMN, имеет участников перечисленных далее типов:… Например, в каждой операции типа «забить гвоздь» будут участвовать объекты следующих типов: «исполнитель», «гвоздь» и «молоток». Правда, есть исключения. Например, иногда в определении типа операции можно встретить ссылку не на тип участника, а на модель конкретного ресурса. Тогда речь идет о том, что в любой операции данного типа участником будет конкретный объект, а не объект какого-то типа, например, в каждой операции класса «получить согласование на постройку здания» указан участник: администрация города Москвы (объект).

Все объекты конструкции принадлежат разным классам

Следующий кейс наиболее распространен: объекты над- и под- относятся к разным классам. Например, трансформатор состоит из сердечника и двух обмоток. В применении к описанию активности можно рассмотреть предыдущий пример в разрезе того, что исполнители относятся к разным классам. Сидоров – к людям, молоток – к инструментам, а гвоздь – к материалам. Все зависит от того, как мы классифицируем объекты.

Описание конструкции без перечисления ее элементов

Следующий кейс посложнее. Мы говорим о конструкции, в которой нет перечисления ее элементов, но есть упоминание о типах объектов, из которых состоит конструкция. Например, здание состоит из кирпичей. Конкретное здание состоит из объектов типа «кирпич». Нет перечисления конкретных кирпичей, но есть указание типа, к которому относятся эти объекты. Моделирование таких конструкций довольно затруднено в современных языках моделирования. Дело в том, что для моделирования таких утверждений нужны предикаты второго порядка. Но языков, которые были бы заточены для моделирования предикатов второго порядка, нет. Причина этого в том, что, если модель, созданная в предикатах первого порядка вычислима, то модель в предикатах второго порядка — нет. То есть, на основе фактов, записанных в предикатах первого порядка, можно строить однозначные выводы. Если же модель построена в предикатах второго порядка, то выводы могут быть только с некоторой долей вероятности. Например, если мы говорим, что лес состоит из осин на 60 процентов и из берез на 30 процентов (остальные деревья относятся к другим породам), то сказать наверняка о породе произвольно взятого дерева в этом лесу можно будет только с некоторой долей вероятности.

Создание ИС ставит перед собой задачу автоматизации некоторых операций. Чаще всего, это детерминированные операции, в которых нет места вероятностным исходам. Программисты в большинстве своем решают именно такие задачи. Поэтому все их инструменты заточены под моделирование предикатов первого порядка, ООП в частности. Поэтому там, где надо моделировать предикаты второго порядка, ООП не справляется.

Примеры

Можно подумать, что такой кейс и правда редкий, однако, моделирование активности предприятия напрямую связано с моделированием такого рода отношений между объектами. Например, мы моделируем конструкцию бизнес-функции. Есть три распространенных способа представить ее конструкцию (парадигмы конструкции). Первый способ был упомянут выше – над-функция представляется в виде конструкции, состоящей из под-функций (нотация IDEF0). Второй способ – конструкция функции состоит из набора ее участников (например, функция продаж состоит из продавца, потенциального покупателя и товара). Этот тип конструкции моделируется в нотации IDEF0 при помощи стрелок, входящих в квадрат «снизу». Третий тип конструкций соответствует текущему кейсу: функция состоит из операций определенного типа. Например, функция продаж состоит из операций по продаже товаров. Функция – объект, операция – объект. Операции по продаже – объекты одного типа. То есть тезис о том, что здание состоит из кирпичей похож на тезис: функция состоит из операций определенного типа. Языка для моделирования такого рода утверждений нет. Как я уже говорил, причина в том, что это утверждение в предикатах второго порядка. Еще один пример такого рода утверждений: кристалл состоит из атомов. Через аналогию с кристаллом мы перейдем к самому сложному для понимания кейсу, связанному с описанием конструкций.

Конструкция из ячеек с объектами разных типов

Пусть есть кристалл. До сего момента мы не рассматривали связи между элементами конструкции как часть конструкции. С этого момента связи нам понадобятся. Понятно, что разделение объекта на части требует описания связей между элементами. При делении на перечисляемые элементы мы можем перечислить и все связи между элементами. Однако, при делении на объекты одного типа без перечисления всех элементов возникает вопрос о том, как описать связи между элементами конструкции? Например, в здании большинство кирпичей имеют связи с другими кирпичами через кладочный раствор. Тогда мы говорим, что здание состоит из кирпичей, каждый кирпич имеет связи с соседними кирпичами. При этом 60 процентов кирпичей имеют 5 соседей, 30 процентов – 4 соседа, 5 процентов – 3 соседа и 5 процентов- 2 соседа. Таким образом, для любого выбранного кирпича из первой группы найдется пять, которые тоже являются частью здания и которые связаны с выбранным кирпичом через кладочный раствор. Теперь напишем то же утверждение относительно бизнес-функции. Функция по продаже состоит из операций по продаже. Предположим, что операции следуют одна за другой. Тогда мы можем сказать, что для любой операции существует предшествующая ей операция того же типа и существует последующая ей операция того же типа. Так мы смоделировали тип связи в конструкции, которая описана типами объектов, но не объектами. Теперь представим себе кристалл более сложного строения, в котором участвуют атомы разных элементов и расположены в сложной кристаллической решетке. Как описать строение такого кристалла? Те, кто занимается описанием и классификацией кристаллов, знают, что способов описания такого рода решетки – бесконечно много. Например, пусть есть одномерная цепочка атомов двух разных типов А и В, чередующихся друг с другом с шагом в один ангстрем. Можно сказать, что кристалл состоит из ячеек, каждая из которых состоит из атомов типа А и В, расположенных через 1 ангстрем, сдвиг между ячейками — 2 ангстрема. (Также верным будет утверждение о том, что кристалл состоит из ячеек, каждая из которых состоит из атомов типа А и В, расположенных через 3 ангстрема. Сдвиг между ячейками – 2 ангстрема и ячейки пересекаются в пространстве. Каждая такая регулярная структура видна на ренгенограмме кристалла. Чтобы ограничить количество вариантов обычно берут наиболее близко расположенные атомы). С другой стороны, можно сказать, что кристалл состоит из атомов двух типов: А и В. Это утверждение похоже на предыдущее, но отличается от него тем, что в первом случае конструкция кристалла состоит из ячеек, а конструкция ячеек, в свою очередь, — из атомов. Во втором случае конструкция кристалла напрямую состоит из атомов. Другой пример: пусть в функции продаж выполняются два типа операций: согласование условий и отгрузка товара. Можно сказать, что функция состоит из ячеек, в каждой из которых есть операция по согласованию условий и операция по отгрузке товара. А можно сказать: функция состоит из операций по согласованию условий и операций по отгрузке товаров. Это два разных утверждения.

Выбор последовательности элементов в типовой ячейке

Посмотрим на последовательность операций: АВАВАВАВ… Мы видим, что цепочка бесконечная и начинать выделение ячеек можно с любого места. Например, сначала птица Феникс родилась из пепла, затем она сгорела, затем родилась из пепла, затем сгорела. Или: сначала птица Феникс сгорела, затем родилась из пепла, затем снова сгорела. Ячейку можно начать в любом месте. Поэтому, чтобы иметь основания для начала, выбирают некоторое условие, которое выполняется для всех операций ячейки. Например, все операции относятся к одной сделке. Условия могут быть любыми, и в общем случае ячейка может начинаться с операции любого типа. Аналитики обычно этого не знают и, чтобы как-то оправдать выбор начальной операции в ячейке, гипнотизируют себя мыслями о том, что цепочка должна иметь мистическую цель. Вместо того, чтобы сказать, что операции в цепочке могут быть объединены в группу по какому-то (в общем случае произвольному) признаку, аналитики придумывают алхимические формулы. Более того, эта алхимия присутствует в определении процесса.

Моделирование предикатов второго порядка при помощи OWL

Стандарт OWL Full позволяет моделировать высказывания второго порядка благодаря тому, что в роли предметов высказывания в нем могут выступать как объекты, так и классы (множества объектов) и даже типы связей, которые могут существовать между объектами (предикаты). Все эти виды сущностей для OWL являются узлами графа, ребра в котором – конкретные утверждения.

Высказывания второго порядка, записанные в виде OWL, как правило, не обеспечивают вычислимости (возможности получения выводов средствами машин логического вывода). Однако не стоит считать это препятствием для реализации автоматизированных систем. В большинстве случаев работа с OWL-моделями происходит в прикладном программном коде и учитывает особенности и ограничения конкретной задачи, а не претендует на «вычисление всего». На практике полностью полагаться на стандартный логический вывод не получается даже при работе даже с высказываниями первого порядка – при большом объеме и разнообразии данных такие задачи требуют слишком больших вычислительных ресурсов.

Существует несколько способов моделирования высказываний о классах на языке OWL. Один из наиболее практически удобных способов состоит в введении специальных классов, объекты которых представляют собой высказывания о классах или предикатах. Приведем пример (для не знакомых со стандартом запишем его на естественном языке):

- Существует класс «Здание»

- Существует класс «Кирпич»

- Существует класс «Требование к составу объекта»

- Существует связь «Относится к объектам класса» между объектами класса «Требование к составу объекта» и классами

- Существует связь «Должны иметь в составе» между объектами класса «Требование к составу объекта» и классами

- Существует объект A, относящийся к классу «Требование к составу объекта», имеющий следующие связи:

- Требование А – относится к объектам – класс «Здание» (это высказывание можно записать как предикат: Относится к объектам (Требование А, класс «Здание») ).

- Требование А – должны иметь в составе – класс «Кирпич»

Можно обобщить функционал требований – изъять из названия класса слова «… к составу объекта», а в число связей класса «Требование» включить указание на предикат, к которому оно относится («Состоит из», «Расположен в»). Таким же способом можно исключить из названия класса и модальность («должен», «может» и др.). Тогда класс будет называться даже не «Требование», а «Утверждение» или «Аксиома». Это добавит полноценный второй уровень к структуре модели, представленной в виде графа. Выбор уровня формализма зависит исключительно от решаемой прикладной задачи.

Автоматизированная система считывает и интерпретирует приведенные выше высказывания, например, таким образом: в составе каждого объекта класса «Здание» должен присутствовать хотя бы один объект класса «Кирпич». Можно и не опускаться на уровень конкретных кирпичей, интерпретируя высказывание по-другому – как утверждение о том, что здание в принципе состоит из объектов класса «Кирпич» (каких именно – не известно). В таком случае могут использоваться другие высказывания о классе «Кирпич» – например о том, что кирпичи (то есть все объекты класса «Кирпич») имеют определенную плотность, массу, теплопроводность и др. Из этого программа сможет сделать вывод о свойствах здания.

В любом случае эта логика – способность интерпретировать объекты класса «Требование к составу объекта» как требования – должна быть заложена в коде, что допустимо в рамках решения конкретных прикладных задач.

Можно пойти немного другим путем – ставить классы не только на вторую позицию в предикате, но и на первую, то есть делать высказывания о классах как таковых:

- Существует класс «Здание»

- Существует класс «Кирпич»

- Существует связь (предикат) «Должен включать объекты, имеющие в составе только объекты класса» между классами и классами

- Класс «Здание» – должен включать объекты, имеющие в составе только объекты класса – класс «Кирпич»

Интерпретация утверждений такого рода, конечно, тоже остается на прикладном программном обеспечении.

Заметим, что некоторые утверждения о классах можно делать и в рамках более строгого формализма OWL, не теряя вычислимости модели при помощи стандартных машин логического вывода. Это достигается использованием ограничений значений свойств (кардинальностей) с квантификаторами: some, only, exactly и др. Еще один способ записи нашего примера таков:

- Существует класс «Здание»

- Существует класс «Кирпич»

- Существует связь «Состоит из»

- Класс «Здание» есть подкласс анонимного класса, для объектов которого значением связи «Состоит из» являются объекты класса «Кирпич»

При сохранении такого высказывания в граф образуются так называемые «пустые узлы». В данном случае пустым узлом будет анонимный класс, для которого задано ограничение. В соответствии с замыслом стандарта OWL, пустые узлы представляют собой утверждения с квантором существования – то есть, в нашем случае, утверждение о том, что существуют такие объекты, которые состоят из кирпичей. Подклассом таких объектов являются здания.

Такая конструкция довольно громоздка, а правила логического вывода – медленны и капризны в применении, поэтому на практике обычно проще обойтись первым или вторым способом.

Заметим, что все это время мы обсуждали высказывание «Здание состоит из кирпичей», смысл которого с логической точки зрения не слишком точен. Не понятно, что мы хотели сказать:

- Что все, что состоит из кирпичей, есть здание,

- Что здание должно состоять только из кирпичей,

- Что здание состоит в том числе и из кирпичей,

и так далее. При реализации автоматизированной системы такие смысловые «люфты» необходимо устранять. Именно поэтому в начале статьи я сразу дал определения терминам, которые буду употреблять в рамках текущей статьи.

Смешанные конструкции

Вернемся к конструкции дерева и посмотрим на тезис: дерево состоит из ветвей, ствола и корней. Этот тезис говорит о том, что конструкция дерева состоит из объекта – ствола и объектов двух разных типов — ветвей и корней.

Пример псевдоконструкции

Рассмотрим частый случай, когда строится диаграмма в нотации IDEF0. Затем одна из функций на этой диаграмме, как часто говорят, «декомпозируется» на диаграмму в нотации BPMN. Это можно встретить в упомянутой мной ранее программе Businessstudio. Поскольку функция – это объект в предметной области, а диаграмма в нотации BPMN – это модель понятия, то мы видим, что происходит ошибка: функция делится на понятие. Этого быть не может. Функция может делиться на ячейки с операциями. В каждой ячейке несколько операций, связанных между собой темпоральными связями. Для всех ячеек вводится понятие ячейки подобного типа. Это понятие моделируется в нотации BPMN. Так будет правильно.

Корреляция конструкций в двух разных парадигмах

Часто встречающийся способ описания объекта выглядит так: рассмотрим конструкцию объекта в двух разных парадигмах, например в парадигме «внешнего» и «внутреннего» строения. Тогда мы пойдем делить объект на части двумя совершенно разными способами. Например, здание будем делить с одной стороны на помещения, а с другой — на технические подсистемы. И вот тут срабатывает очень важный фактор, который мы, как правило, не замечаем, но он работает на уровне интуиции. Мы делим объект на части в двух разных парадигмах таким способом, что между элементами конструкций в двух разных парадигмах тоже можно установить соответствие. Например, после деления здания на помещения и подсистемы мы можем сказать, что и помещения можно поделить на части — части тех подсистем, которые находятся в этих помещениях. То есть, деление на части в двух разных парадигмах интуитивно делается зависимым друг от друга образом. И это отнюдь не очевидно. Современные стандарты инженерного проектирования основаны именно на таком делении объекта, хотя, я уверен, что в них нет прописанного требования о подобном ограничении на моделирование.

Задача классификации (Classification problem) · Loginom Wiki

Разделы: Бизнес-задачи, Алгоритмы

Loginom: Логистическая регрессия (обработчик), Нейросеть (классификация) (обработчик)

В искусственном интеллекте и машинном обучении — задача разделения множества наблюдений (объектов) на группы, называемые классами, на основе анализа их формального описания. При классификации каждая единица наблюдения относится определенной группе или номинальной категории на основе некоторого качественного свойства.

Пусть X — множество описаний объектов, Y — конечное множество номеров (имен, меток) классов. Существует неизвестная целевая зависимость — отображение y∗:X→Y, значения которой известны только на объектах конечной обучающей выборки Xm=(x1,y1),…,(xm,ym). Требуется построить алгоритм a:X→Y, способный классифицировать произвольный объект x∈X.

В математической статистике задачи классификации называются также задачами дискриминантного анализа.

В машинном обучении задача классификации решается с использованием обучения с учителем, поскольку классы определяются заранее и для примеров обучающего множества метки классов заданы. Аналитические модели, решающие задачу классификации, называются классификаторами.

Задача классификации представляет собой одну из базовых задач прикладной статистики и машинного обучения, а также искусственного интеллекта в целом. Это связано с тем, что классификация является одной из наиболее понятных и простых для интерпретации технологий анализа данных, а классифицирующие правила могут быть сформулированы на естественном языке.

К числу распространенных методов решения задачи классификации относятся:

Задача классификации применяется во многих областях:

- в торговле — классификация клиентов и товаров позволяет оптимизировать маркетинговые стратегии, стимулировать продажи, сокращать издержки;

- в сфере телекоммуникаций — классификация абонентов позволяет определять уровень лояльности, разрабатывать программы лояльности;

- в медицине и здравоохранении — диагностика заболеваний, классификация населения по группам риска;

- в банковской сфере — кредитный скоринг.

1.3. Методы классификации информации — СтудИзба

· 1.3. Методы классификации информации

Классификация –это система распределения объектов (предметов, явлений, процессов, понятий) по классам в соответствии с определенным признаком.

Под объектом понимается любой предмет, процесс, явление материального или нематериального свойства. Применительно к информации существуют информационные объекты.

Пример. В университете, например, существуют объекты: информация о студентах – объект «студент»; информация о преподавателях – объект «преподаватель»; информация о факультетах – объект «факультет» и т.д.

Свойства информационного объекта определяются реквизитами. Реквизиты представляются либо числовыми данными, например, все, стоимость, год, либо признаками, например, цвет, марка машины, фамилия.

Реквизит – логически неделимый информационный элемент, описывающий определенное свойство объекта, процесса, явления и т.п.

Пример. Информация в студенте представлена следующими реквизитами: фамилия, имя, отчество, пол, год рождения, место рождения, адрес домашний, факультет и т.д.

Классификация нужна для выявления общих свойств информационного объекта, а также для разработки правил (алгоритмов) и процедур обработки информации. При классификации необходимо соблюдать следующие требования:

Рекомендуемые файлы

-полнота охвата объектов рассматриваемой области;

-однозначность реквизитов;

-возможность включения новых объектов.

В любой стране разработаны и применяются государственные, отраслевые, региональе классификаторы. Например, классифицированы отрасли промышленности, оборудование, профессии, единицы измерения, статьи затрат и т.д.

Классификатор – систематизированный свод наименований и кодов классификационных группировок.

Код – это условное обозначение объекта или явления в виде знака или системы знаков, построенное по определенным правилам.

При классификации пользуются понятием классификационного признака, который позволяет установить сходство или различие объектов.

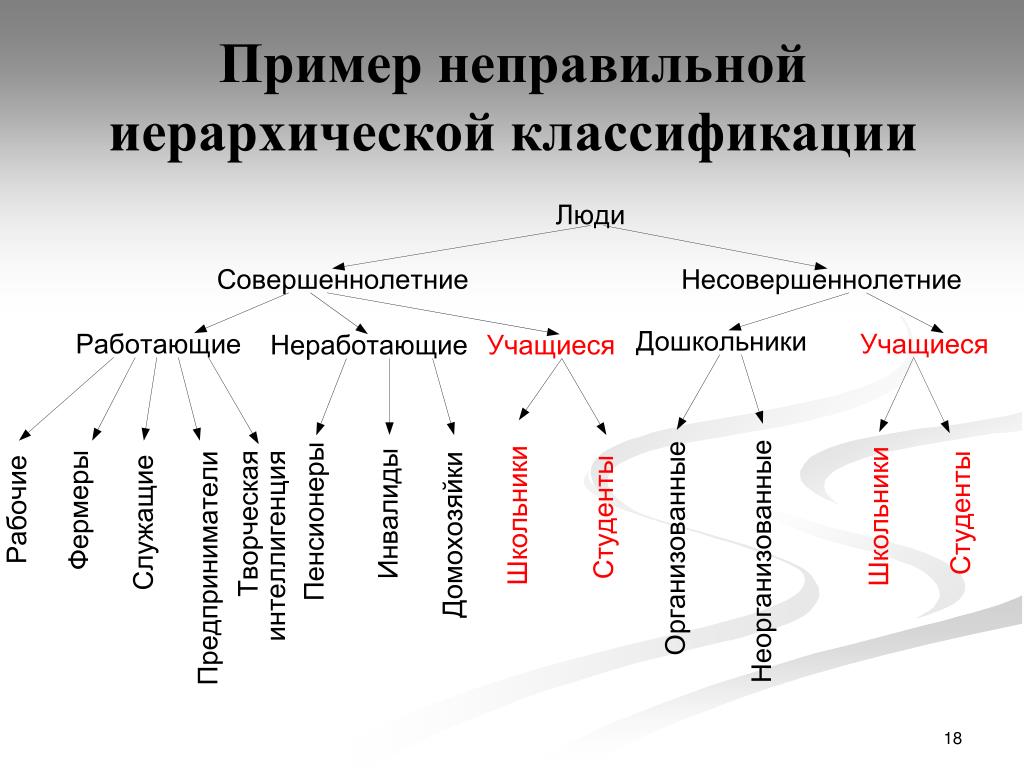

Разработаны три метода классификации объектов: иерархический, фасетный, дескрипторный.

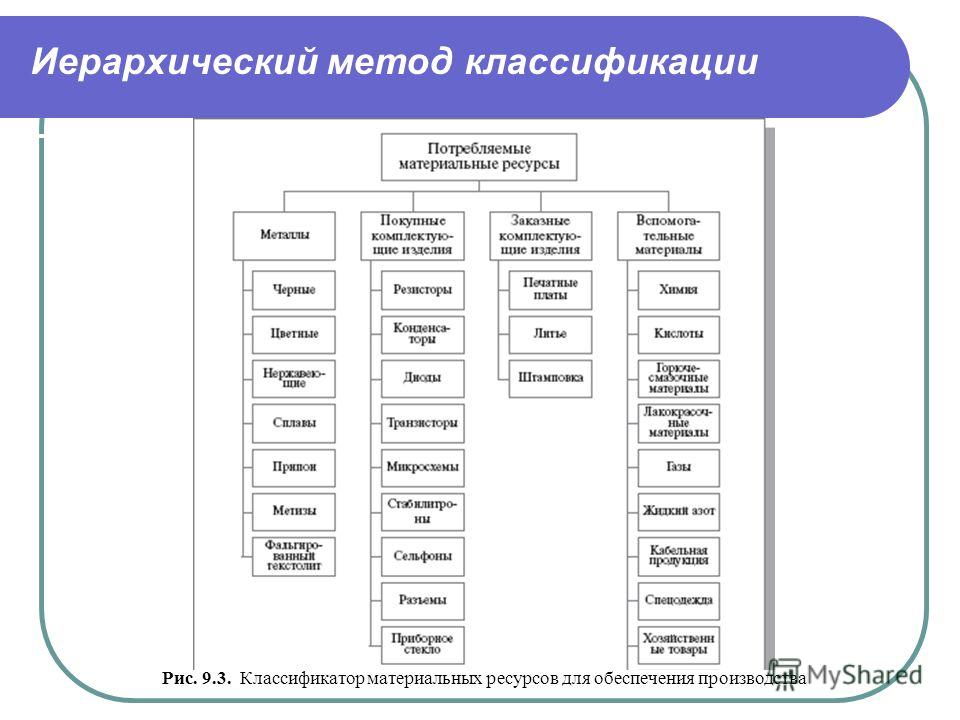

Иерархический метод классификации устанавливает между классификационными группировками иерархические отношения подчинения, с последовательной детализацией их свойств: класс, подкласс, группа, подгруппа, вид и т.д.

0 уровень

1уровень

2 уровень

3 уровень

Достоинства:

-простота построения;

-использование независимых классификационных признаков в различных ветвях иерархической структуры.

Недостатки:

-жесткая структура, которая приводит к сложности внесения изменений, т.к. приходится перераспределять все классификационные группировки;

-невозможность группировать объекты по заранее не предусмотренным сочетаниям признаков.

Пример иерархической системы классификации для информационного объекта «факультет»:

0 уровень

1-название ф-та Коммерческий Информационные

(классификационный системы

признак)

2-возраст до 20 лет 20-30 лет свыше 30 лет до 20 лет 20-30 лет свыше 30 лет

3-пол м ж м ж м ж м ж м ж м ж

4-наличие детей есть нет есть нет есть нет есть нет есть нет есть нет

у женщин

Метод фасетной классификации основан на множестве независимых признаков. Набор таких признаков может быть произвольным, что позволяет группировать объекты по любому сочетанию признаков. Является одноуровневым, исходное множество объектов разбивается на подмножества классификационных группировок в соответствии со значениями признаков отдельных фасетов. Фасеты независимы между собой.

Схема построения фасетной системы классификации в виде таблицы:

|

| фасеты | ||||||

|

| |||||||

значения фасетов |

| Ф1 | Ф2 | Ф3 | … | Фi | … | Фn |

1 |

|

|

|

|

|

|

| |

2 |

|

|

|

|

|

|

| |

… |

|

|

|

|

|

|

| |

k |

|

|

|

|

|

|

| |

Достоинства:

-возможность создания большой емкости классификации, т.е. использование большого числа признаков классификации и их значений для создания группировок;

-возможность простой модификации всей структуры существующих группировок.

Недостатком фасетной системы классификации является сложность ее построения, т.к. необходимо учитывать все многообразие классификационных признаков.

Пример.

Наименование факультета | Возраст | Пол | Дети |

Радиотехнический | до 20 лет | м | есть |

Машиностроительный | 20-30 лет | ж | нет |

Коммерческий | свыше 30 лет |

|

|

Информационные системы |

|

|

|

Математический |

|

|

|

Суть дескрипторного метода классификации:

-отбирается совокупность ключевых слов или словосочетаний, описывающих определенную предметную область или совокупность однородных объектов, среди которых могут находиться синонимы;

Лекция «4. Способы подготовки шахтных полей» также может быть Вам полезна.

-выбранные ключевые слова нормализуются, т.е. из совокупности синонимов выбираются наиболее употребимые;

-создается словарь дескрипторов, т.е. словарь отобранных слов и словосочетаний.

Пример. Объект классификации – успеваемость студентов. Ключевые слова: оценка, экзамен, зачет, преподаватель, студент, семестр, название предмета. Синонимов нет, эти ключевые слова можно использовать как словарь дескрипторов.

Предметная область: учебная деятельность в вузе. Ключевые слова: студент, обучаемый, учащийся, преподаватель, учитель, педагог, лектор, ассистент, доцент, профессор, коллега, факультет, аудитория, лекция, практическое занятие и т.д. Встречаются синонимы. После нормализации словарь дескрипторов будет состоять из следующих слов: студент, преподаватель, лектор, ассистент, доцент, профессор, факультет, аудитория, лекция, практическое занятие и т.д.

Иерархическая классификация товаров, примеры

Понятие и сущность иерархической классификации товаров в маркетинге

Определение 1

Иерархическая классификация товаров – это группировка товарного ассортимента компании по подчиненным подмножествам.

Многие фирмы производят и/или продают множество различных видов товарной продукции. Для целей маркетинга и управления их принято подвергать определенной группировке по тем или иным основаниям, то есть классификации. Классификация представляет собой ни что иное как процедура группировки, проводимая на качественном уровне и основанная на выделении однородных свойств объектам. В маркетинге классификация товаров используется довольно часто.

Товары могут быть классифицированы по различным основаниям. В соответствии с этими основаниями выделяются различные классификационные методы. Метод иерархической классификации товарной продукции подразумевает необходимость последовательного разделения множества товарных групп на подчиненные классификационные группировки.

Отличительной особенностью данного метода классификации выступает наличие тесной связи между отдельными классификационными группировками, которая выявляется посредством анализа общности и различий основополагающих признаков. Фундаментальной основой деления множества товаров на подмножества выступает ступень классификации.

Под ступенью классификации принято понимать этап классификационного процесса, основанного на иерархическом методе, по окончании которого выделяется определенная совокупность классификационных группировок. Глубина классификации определяется количеством ступеней и признаков. Если глубина слишком большая, классификация товаров становится слишком запутанной и громоздкой. В этом случае многие низшие ступени начинают дублировать друг друга. Все это ограничивает возможности практического использования иерархической классификации товаров. Согласно общепринятому правилу количество ступеней, то есть глубина классификации не должна превышать десяти.

Замечание 1

Каждую группировку и ступень классификации следует выделять по основополагающему признаку, выбору которого в маркетинге отводится особая роль.

Готовые работы на аналогичную тему

В основе выбора классификационных признаков лежит целевое назначение классификации. Число признаков ограничено, если их требуется увеличить, следует отказаться от иерархического метода классификации товаров в пользу использования фасетного метода.

Использование иерархической классификации товарной продукции предполагает необходимость подразделения всего множество товарной продукции на подчинённые подмножества, которые все вместе составляют единую систему, состоящую из элементов, сходных как минимум по одному признаку. Структура иерархической классификации товаров включает в себя:

- группы;

- подгруппы;

- виды;

- подвиды и пр.

Иерархическая классификация позволяет структурировать множественные товары, формирующие собой ассортиментный ряд продукции фирмы и использовать полученные группы для дальнейшего анализа, оптимизации и управления. Используется подобного рода классификация и в сфере разработки стратегии продвижения продукции, совершенствовании ассортиментного ряда, формирования системы сбыта и пр.

Иерархическая методика классификации товаров, используемая в маркетинге, имеет свои преимущества и недостатки. К основным достоинством данной классификационной системы принято относить:

- высокую информативную насыщенность;

- способность к выделению общности и сходства признаков товарной продукции на одной и/или разных ступенях.

В то же время иерархическая классификация не лишена недостатков, которые наиболее ярко проявляются при ее чрезмерной глубине, ограничивая тем самым возможности ее использования для исследовательских и управленческих целей. К подобного рода ограничениям и недостаткам принято относить громоздкость структуры, высокие затраты на ее построение, а также трудность применения. К числу прочих недостатков, проявляющихся при незначительной глубине, относятся: неполный охват признаков и объектов, а также информационная недостаточность.

Замечание 2

Несмотря на наличие описанных выше недостатков, данная система классификации товарной продукции получила широкое общественное признание и была взята на вооружение многими специалистами в сфере товароведения, маркетинга и управления.

Примеры иерархической классификации товаров в маркетинге

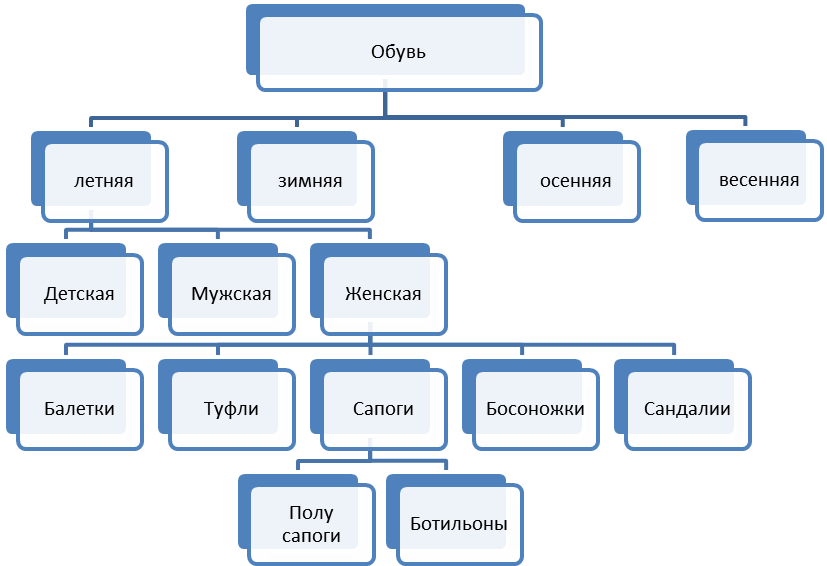

Иерархическая система классификации товарной продукции весьма часто используется на практике. Рассмотрим лишь некоторые примеры ее применения, но прежде обратится к типовой классификационной схеме, представленной на рисунке 1.

Рисунок 1. Базовая схема иерархической классификации. Автор24 — интернет-биржа студенческих работ

Таким образом, заданное на нулевом уровне множество по первому классификационному признаку делится на подмножества первого уровня. Выделенные на первом уровне подмножества, в свою очередь, также делятся на подмножества по второму классификационному признаку и так далее, максимально – вплоть до 10 уровня. Приведем пример.

Предположим, что магазин специализируется на продаже клея. По природе своего происхождения клей может быть природным или синтетическим. В данном случае природа возникновения выступает классификационным признаком первого уровня. Каждая из групп подлежит дальнейшей классификации. Клей природного происхождения может быть минеральным, растительным или животным. Клей природного животного происхождения в свою очередь делится на альбуминовую, казеиновую и колагеновую группу, состоящую из мездрового и костного клея. Клей синтетического происхождения делится на созданные на основе термоактивных и термопластичных смол, а также синтетических каучуков. Таким образом, данная иерархическая классификационная цепочка состоит из пяти уровней.

Рассмотрим другие примеры.

Виноградные вина подлежат множественной классификации. По насыщенности диоксидом углерода их подразделяют на тихие и перенасыщенные. Тихие вина, в свою очередь, делятся на натуральные и специальные. Группа пересыщенных вид состоит из газированных или шипучих вин, игристых вин и шампанского. В данном случае классификационная структура имеет три уровня иерархии.

Широкой иерархической классификации может быть подвержена обувь. Так, например, в зависимости от сезона года, для которого она предназначена, ее делят на четыре укрупненных группы:

- весенняя;

- летняя;

- осенняя;

- зимняя.

Рассмотрим дальнейшую классификацию на примере летней обуви. Летняя обувь в зависимости от того, кто ее носит, делится на детскую, мужскую и женскую. Женская обувь по своему типу делится на туфли, балетки, сандалии, босоножки.

Весьма часто иерархическая классификация используется в рамках товарной номенклатуры. В этом случае используются следующие уровни классификации товаров. Первый уровень составляют разделы, на втором уровне используются группы, третий уровень представлен товарными позициями, четвертый уровень и ниже – более низкие уровни детализации.

VIII. Принципы классификации

Информация об изобретении Дополнительная информация Технические объекты изобретений Подразделения в классификации для классифицирования технических объектов изобретений Функционально-ориентированные и отраслевые подразделения Классификация технической сущности изобретений Общие замечания Категории тематики, для которой нет соответствующего точного заголовка рубрики МПК Периодическая Таблица химических элементов Химические соединения Химические смеси или композиции (составы) Получение и обработка химических соединений Устройства или способы Изделия Многоступенчатые способы, агрегаты (установки) Детали, конструктивные элементы Общие химические формулы Комбинаторные библиотеки 75. Основным назначением классификации, как отмечено в п. 6, является облегчение поиска технических решений. В связи с этим классификация разработана и должна использоваться таким образом, чтобы одинаковые технические решения классифицировались одинаково и, следовательно, могли быть найдены в одном и том же месте классификации. Это место должно быть самым подходящим для проведения поиска таких технических решений.

76. В патентном документе может быть два типа информации. Это «изобретательская информация» и «дополнительная информация». Значение этих выражений объясняется ниже в п.п. 77-80. Правила выбора классификационных индексов одинаковы для обоих типов информации (см. также главу XI ниже). Хотя в «Руководстве к МПК» упоминаются только изобретения или технические объекты изобретений, это в равной мере относится к техническим объектам, охватываемым дополнительной информацией.

ИНФОРМАЦИЯ ОБ ИЗОБРЕТЕНИИ

77. Изобретательская информация — это техническая информация, раскрываемая в патентном документе (например, описании, рисунках, патентной формуле), которая представляет дополнение к уровню техники. Изобретательская информация определяется в контексте с уровнем техники, используя в качестве руководства патентную формулу патентного документа, уделяя дополнительное внимание описанию и рисункам.

78. «Дополнение к уровню техники» означает все новое и неочевидное в технической сущности, особо раскрытое в патентном документе, что не является частью предшествующего уровня, т.е. разница между технической сущностью патентного документа и подборкой всех знаний о технической сущности, доступной публике.

ДОПОЛНИТЕЛЬНАЯ ИНФОРМАЦИЯ

79. Дополнительная информация — это техническая информация, которая сама по себе не является дополнением к уровню техники, но может представлять полезную информацию для поиска.

80. Дополнительная информация сопровождает изобретательскую информацию, указывая, например, составляющие композиции или смеси, или элементы или компоненты способа или конструкции, или использование классифицируемых технических объектов.

КАТЕГОРИИ ТЕХНИЧЕСКИХ ОБЪЕКТОВ ИЗОБРЕТЕНИЯ

81. Техническими объектами изобретений могут быть новые и неочевидные способы, продукты, устройства или материалы (или способы их использования или применения). Эти термины, обычно используемые для категории технического объекта, следует интерпретировать в широком смысле, как указано в следующих примерах:

(а) Примеры способов: полимеризация, ферментация, разделение, формование, транспортирование, обработка текстиля, передача и преобразование энергии, строительство, приготовление пищи, испытание, методы работы на машинах и способы их работы, обработка и передача информации.

(б) Примеры продуктов: химические соединения, составы, ткани, промышленные изделия.

(в) Примеры устройств: установки для проведения химических или физических процессов, инструменты, орудия, машины, устройства для выполнения технических операций.

(г) Примеры материалов: ингредиенты смеси.

82. Следует отметить, что устройство можно также рассматривать как продукт, в том смысле, что каждое устройство произведено в результате выполнения определенного процесса. Термин «продукт», однако, используется для обозначения конечного результата процесса независимо от его последующей функции, например, конечный продукт химического или производственного процесса, тогда как термин «устройство», как правило, предполагает его использование по определенному назначению или для определенной цели, например устройство для генерирования газов, устройство для резания. Материалы сами по себе могут составлять продукты.

ПОДРАЗДЕЛЕНИЯ В КЛАССИФИКАЦИИ ДЛЯ КЛАССИФИЦИРОВАНИЯ ТЕХНИЧЕСКИХ ОБЪЕКТОВ ИЗОБРЕТЕНИЙ

83. Классификация разработана для обеспечения классифицирования любой технической сущности изобретения в целом, а не по отдельным составным частям.

84. Составные части технического объекта изобретения могут также составлять изобретательскую информацию, если они сами по себе представляют дополнение к уровню техники, т.е. являются новыми и неочевидными объектами.

ФУНКЦИОНАЛЬНО-ОРИЕНТИРОВАННЫЕ И ОТРАСЛЕВЫЕ ПОДРАЗДЕЛЕНИЯ

85. Техническая сущность изобретений, описываемая в патентных документах, касается либо самой природы или функции какого-либо объекта, либо способа применения или использования объекта. В связи с этим термин «объект» используется для обозначения как осязаемых, так и неосязаемых технических объектов, например, способа, продукта, устройства. Вышеупомянутое находит отражение в строении схемы классификации. Она содержит рубрики для классифицирования:

а) объекта «вообще», т.е. характеризующегося своей природой или функцией; объекта, который либо не зависит от какой-либо конкретной области его применения, либо остается технически неизменным, если отвлечься от области применения, т.е. не приспособленным специально для использования в какой-то области;

Примеры:

(1) Подкласс F 16К предусмотрен для клапанов, характеризуемых конструктивными или функциональными свойствами, которые не зависят от особенностей текучей среды, проходящей через него, или от системы, частью которой он является.

(2) Класс С07 предусмотрен для органических химических соединений, характеризующихся их химической структурой, а не их применением.

(3) Подкласс В01D предусмотрен для фильтров вообще.

(б) объекта «специально приспособленного для» особого использования или цели, т.е. модифицированного или сконструированного специально для данного использования или цели;

Пример: A61F 2/24 – рубрика для механического клапана, специально приспособленного для человеческого сердца.

(в) особого использования или применения объекта;

Пример: Фильтры, специально приспособленные для особых целей, или комбинации их с другими устройствами, классифицируются в отраслевых рубриках, например A24D 3/00, A47J 31/06.

(г) встраивание объекта в большую систему.

Пример: B60G имеет подразделение для встраивания рессор в подвеску колес транспортного средства.

86. Подразделения категории (а), указанные выше, называются “функционально-ориентированными подразделениями”. Подразделения категории (б) — (г), указанные выше, называются «ориентированными по применению» подразделениями.

87. Подразделения, например, подклассы, не всегда следует рассматривать как полностью функционально — ориентированными или полностью ориентированными по применению по отношению к другим подразделениям МПК.

Пример: Несмотря на то, что подклассы F16K (клапаны и т.д.) и F16N (смазка) являются по своему содержанию функциональными, подкласс F16N содержит рубрики для некоторых клапанов, специально предназначенных для смазочных устройств или систем (например, F16N 23/00 – обратные клапаны для смазочных устройств), и, наоборот, подкласс F16К содержит отраслевые рубрики для смазочных устройств в шиберных затворах или золотниках (например, F16К 3/36 – конструктивные особенности, относящиеся к смазке).

Выражения «функционально-ориентированное подразделение» и «ориентированнoе по применению подразделение» не всегда могут рассматриваться в их абсолютном значении. Подразделение может быть более функциональным, чем другое рассматриваемое подразделение, но менее функциональным, чем другие подразделения по отношению к какой-либо тематике.

Пример: Группа F02F 3/00 относится к поршням двигателей внутреннего сгорания вообще и, следовательно, является более функционально-ориентированной, чем группа F02B 55/00, которая специально предназначена для вращающегося типа поршней двигателей внутреннего сгорания, но менее функционально-ориентированной, чем подкласс F16J, который предназначен для поршней вообще.

87 бис. В МПК существуют также подразделения, которые применяются для классифицирования только при условии, если не существует другого места в МПК для рассматриваемой тематики. Такие подразделения относятся к «остаточным».

Выражения, приведённые ниже и используемые в заголовках соответствующих подразделений, ясно указывают на «остаточный» характер этих подразделений:

— «не предусмотренные в других рубриках МПК»,

— «не предусмотренные в…»,

— «не охватываемые …».

«Остаточная» природа подразделения может быть относительной по отношению к другим подгруппам, другим основным группам того же подкласса, другим подклассам или даже ко всей МПК. Основные группы с номером 99/00 по всей МПК являются специально выделенными остаточными подразделениями.

Примеры: F21S 15/00 Неэлектрические осветительные устройства или системы с применением источников света, не отнесенных к основным группам F21S 11/00, F21S 13/00 или F21S 19/00

G06Q 99/00 Тематика, не предусмотренная в других группах данного подкласса

A99Z Тематика, не предусмотренная в этом разделе

F21K источники света, не предусмотренные в других рубриках МПК

КЛАССИФИКАЦИЯ ТЕХНИЧЕСКОЙ СУЩНОСТИ ИЗОБРЕТЕНИЙ

Общие замечания

88. Очень большое значение имеет правильное определение или выявление технической сущности изобретений. При этом следует иметь в виду, что для определения наиболее подходящего места в классификации объект следует рассмотреть в отношении каждой категории, представленной в п.п. 81-85.

Пример: Если в патентном документе раскрыт поршень, то необходимо рассмотреть вопрос о том, является ли технической сущностью изобретения поршень как таковой или, например, специальное приспособление поршня для использования в особых устройствах, или размещение поршней в целой системе, например, в двигателе внутреннего сгорания.

89. Часто информация об изобретении касается только определенной технической области использования. В этом случае изобретение будет полностью классифицировано в ориентированном по применению подразделении. Функционально-ориентированные подразделения разработаны на основании другого подхода. Его суть в том, что конструктивные и функциональные особенности объекта изобретения, которые классифицируются в этих подразделениях, относятся к нескольким областям применения и применение в какой-то определенной области не является информацией об изобретении.

Пример: Группа С09D 5/00 охватывает составы для нанесения покрытий для различных областей применения (например, С09D 5/16 охватывает противообрастающие краски). Группы С09D 101/00-201 /00 охватывают функционально-ориентированные аспекты составов для покрытия, а именно полимер, на котором состав основан.

90. Когда при классифицировании технической сущности возникают сомнения в выборе функционально-ориентированного или ориентированнoго по применению подразделения, необходимо руководствоваться следующим:

(а) Если определенная область применения упомянута, но детально не раскрыта или не определена полностью, классифицирование проводится в функционально-ориентированном подразделении, если таковое имеется. То же относится к случаю, когда широко заявлено несколько областей применения.

(б) Если технически существенные характеристики объекта относятся к самой природе или функции объекта, а также к области его применения или специальному приспособлению или встраиванию в целую систему, то классифицирование проводится и в функционально-ориентированном и в ориентированнoм по применению подразделениях, если таковые имеются.

(в) Если таких ориентиров, как (а) и (б), нет, классифицирование проводится и в функционально-ориентированном, и в ориентированнoм по применению подразделении.

91. При классифицировании большой системы (комбинации) в целом следует уделять внимание частям или деталям. Если они являются новыми и неочевидными, классифицирование и системы, и этих частей или деталей является необходимым.

Пример: В том случае, если документ относится к встраиванию какого-либо объекта, например, листовой рессоры, в целую систему, например, в подвеску колес транспортного средства, это означает, что он относится к целой системе и должен быть проклассифицирован в подразделении для этой системы (B60G). Если документ относится также к объекту как таковому, например, к листовой рессоре как таковой, и является новым и неочевидным, документ необходимо классифицировать также в подразделении для этого объекта (F16F).

Категории тематики, для которой нет соответствующего точного заголовка рубрики МПК

92. Из п.п. 81 и 82 следует, что техническая сущность изобретения может выражаться различными категориями объектов. Если для одной из этих категорий нельзя подобрать точно рубрику с соответствующим заголовком, для классифицирования выбирается наиболее подходящая рубрика, предусмотренная для других категорий объектов (см. п.п. 93-99 для конкретных ситуаций). В таких ситуациях, даже если заголовок рубрики не совсем явно предусматривает эту категорию объекта, возможны другие указания на нее, такие как отсылки, примечания, определения или упоминания о подобной тематике в других группах (подгруппах) данной части схемы. Определения, если таковые имеются, должны давать конкретную информацию о классификационных рубриках для подходящих категорий объектов, не указанных в заголовках рубрик.

Периодическая Таблица химических элементов

92 бис. Во всех разделах МПК при отсутствии особого указания Периодическая Система химических элементов, на которую содержится ссылка, является Системой с восьмью группами, как представлено ниже в Таблице. Например, в группе C07F 3/00 “Соединения, содержащие элементы 2-ой группы Периодической системы” имеются в виду элементы колонок IIA и IIB.

Химические соединения

93. Сущность изобретения, относящегося к химическому соединению (органическому, неорганическому или высокомолекулярному), классифицируется в разделе C в соответствии с его химической структурой. Если сущность изобретения относится также к определенной области его применения, то химическое соединение классифицируется также и в рубрике для этой области применения, если таковая является существенно важной технической характеристикой предмета изобретения. Однако, в случае, когда химическое соединение уже известно, а сущность изобретения относится исключительно к применению химического соединения, то изобретение классифицируется в рубрике, соответствующей области его применения, как информация об изобретении. При этом химическая структура соединения может быть также проклассифицирована в рубрике для химического соединения, как такового.

Химические смеси или композиции (составы)

94. Сущность изобретения, относящаяся к смесям или композициям (составам), классифицируется в тех подразделениях, которые соответствуют (если они существуют) их химическому составу, например в С03С (стекло), С04B (цемент, керамика), С08L (композиции органических высокомолекулярных соединений), С22С (сплавы). Если подходящее подразделение отсутствует, объект изобретения классифицируется в соответствии с областью его применения или использования. В тех случаях, когда применение или использование является существенным признаком изобретения, смесь или композиция классифицируются как по их химическому составу, так и по области применения или использования. Но, если данная химическая смесь или композиция известна, а сущность изобретения относится только к ее применению, то она классифицируется в рубрике, соответствующей области применения, как информация об изобретении. При этом смесь или композиция может также быть проклассифицирована в рубрике для данной химической смеси или композиции, как таковой.

Получение и обработка химических соединений

95. Сущность изобретения, касающаяся способа получения или обработки химического соединения, классифицируется в подразделении, соответствующем данному способу получения или обработки рассматриваемого химического соединения, а если такой рубрики не существует, то в рубрике, соответствующей данному химическому соединению. Если соединение, образующееся в результате данного процесса получения, является новым, то его следует также классифицировать в рубрике, соответствующей его химическому строению. Техническая сущность изобретения, касающаяся общих способов получения или обработки целых классов химических соединений, классифицируется в рубриках для способов, если такие рубрики существуют.

Устройства или способы

96. Сущность изобретения, касающаяся устройства, классифицируется в рубрике для данного устройства, если таковая существует. Если же для такого устройства специальной рубрики не существует, то устройство классифицируется в рубрике, соответствующей способу, в котором используется это устройство. Сущность изобретения, касающаяся способа изготовления или обработки продуктов, классифицируется в рубрике для применяемого способа. Если такой рубрики не существует, то изготовление или обработка продуктов классифицируется в рубрике для устройства, которое используется в данном способе. Если не существует рубрики для изготовления продукта, то устройство для изготовления или способ классифицируется в рубрике, соответствующей данному продукту.

Изделия

97. Сущность изобретения, касающаяся изделия, классифицируется в рубрике, соответствующей этому изделию. Если для изделия как такового не существует подходящей рубрики, оно классифицируется в подходящем функционально-ориентированном подразделении (т.е. в соответствии с функцией, выполняемой данным изделием) или, если таковое отсутствует, в соответствии с областью применения этого изделия.

Например: Если изделием, подлежащим классифицированию, является распылитель клея, специально предназначенный для книжных переплетов, то оно классифицируется в группе B42C 9/00 «Использование клея или склеивающих веществ в переплетном производстве». Поскольку не существует специальной рубрики для распылителей клея для переплетных работ, то они классифицируются в рубрике, соответствующей их функции, т.е. «использование клея».

Многоступенчатые способы, агрегаты (установки)

98. Сущность изобретения, заключающаяся в многоступенчатом способе или промышленном агрегате, которые состоят из комбинации стадий процесса или комбинации нескольких устройств в едином агрегате, классифицируется как нечто целое, т.е. в подразделении, соответствующем такой комбинации, например в подклассе B09B. Если такого подразделения не существует, изобретение классифицируется в подразделении, соответствующем продукту, получаемому в результате использования такого многоступенчатого способа или агрегата. Если сущность изобретения касается также отдельного элемента комбинации, например, отдельной стадии процесса или отдельной машины агрегата, то такой элемент классифицируется обособленно в соответствующей рубрике.

Детали, конструктивные элементы

99. В тех случаях, когда техническая сущность изобретения касается конструктивных элементов или деталей объекта, например, устройств, применяются следующие правила:

(а) если конструктивные элементы или детали предназначены или могут использоваться только для одного определенного объекта, то они классифицируются в рубриках, соответствующих этому объекту, если такие рубрики существуют;

(б) при отсутствии таких рубрик эти конструктивные элементы или детали классифицируются в рубрике, предназначенной для рассматриваемой тематики;

(в) конструктивные элементы или детали, которые могут использоваться в нескольких видах объектов, классифицируются в рубриках более общего характера, если таковые существуют;

(г) при отсутствии таких рубрик более общего характера, данные конструктивные элементы или детали классифицируются в рубриках, соответствующих всем видам объектов, к которым они точно относятся.

Например: В подклассе A45B группы 11/00-23/00 охватывают различные виды зонтов, а группа 25/00 – детали зонтов, которые могут использоваться более, чем для одного типа зонтов.

Общие химические формулы

100. Большое количество химических соединений часто выражается или заявляется в виде общих формул. Общие формулы представляют родовое химическое соединение, по крайней мере, с одним компонентом формулы, являющимся переменным, выбранным из специфической подборки альтернатив (например, формулы «Маркуша»). Использование общих формул вызывает проблемы при классифицировании, когда они охватывают большое количество соединений, которые могут быть отдельно проклассифицированы в большом количестве рубрик. В таких ситуациях классифицируются только индивидуальные химические соединения, наиболее полезные для поиска. Если химические соединения описываются с использованием общей химической формулы, должна применяться следующая процедура классифицирования.